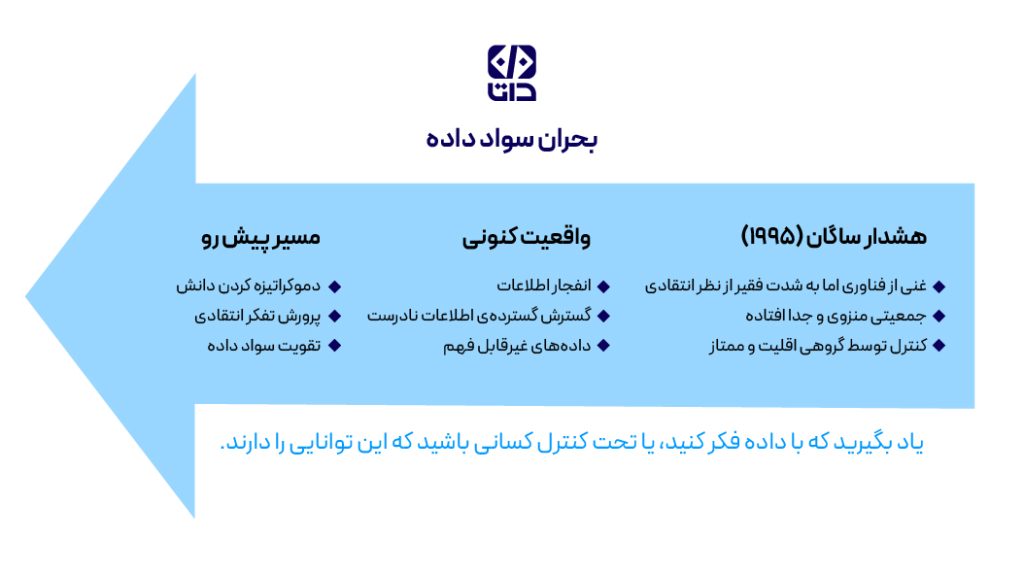

«کارل ساگان» (Carl Edward Sagan) اخترشناس و نویسندهی آمریکایی، از پیشگامان اخترزیستشناسی و بنیانگذاران طرح جستوجوی هوش فرازمینی (SETI) نسبت به آیندهای هشدار داد که در آن، با وجود وفور دادهها، سردرگمی و اطلاعات نادرست همچنان پابرجا باقی بمانند. آیا اکنون در همان آینده زندگی میکنیم؟

سواد داده برای حرکت در این چشمانداز و تضمین تصمیمگیری آگاهانه و عادلانه، از تصمیمگیریهای مبتنی بر هوش مصنوعی تا نابرابریهای فزاینده در دسترسی به دادهها، ضروری است.

تاریخ به انحای مختلف تکرار میشود. قدرت در جهان امروز ما، مانند دوران انقلاب صنعتی دیگر ماشین نیست. بلکه داده و هوش مصنوعی است. و آنهایی که آن را نمیفهمند، فقط عقب نمیمانند، بلکه توسط کسانی که به موقع آن را درک میکنند، اداره خواهند شد.

در سال ۱۹۹۵، کارل ساگان در کتاب «جهانی تسخیرشده با ارواح: علم همچون شمعی در تاریکی» آیندهای نگرانکننده را پیشبینی کرد. او جامعهای را ترسیم کرد که سرشار از پیشرفتهای فناورانه و اطلاعات فراوان است، اما به طرز خطرناکی از تفکر انتقادی، سواد علمی و توانایی تشخیص حقیقت از دروغ تهی است. هراس ساگان از مردمی بود که از دانشی که برای مشارکت معنادار در تصمیمگیریهای مدنی و اجتماعی نیاز دارند، جدا شدهاند و کنترل را در دستان اقلیتی ممتاز رها کردهاند. اکنون، تقریبا سه دهه بعد، پیشبینی او به طرز عجیبی تحقق یافته به نظر میرسد. پرسش این است: آیا اکنون در «جهان تسخیرشده با ارواح» ساگان زندگی میکنیم؟

امروزه، جامعه ما غرق در دادههاست. از لحظهای که بیدار میشویم و به گوشی هومشندمان نگاه میکنیم، با نمودارها، آمار، پیشبینیها و تحلیلها مواجه میشویم. با این حال، وفور داده لزوما به تصمیمگیری بهتر یا جامعهای آگاهتر منجر نشده است. بلکه اغلب باعث سردرگمی، اطلاعات نادرست و دوقطبی شدن شده؛ بازتابی معاصر از هشدار ساگان. اکنون آشوب داریم، چرا که هیچکس نمیداند چه چیز را باید باور کند.

در قلب این چالش، سواد داده قرار دارد: توانایی خواندن، درک، ایجاد و انتقال مؤثر دادههای کمی و کیفی. این تنها به معنای درک داده نیست. به معنای پرورش تفکر انتقادی برای پرسش از منابع، ارزیابی قابلیت اعتماد آنها و قرار دادن داده در بستر مناسب است. بدون این مهارت، دادهها در بهترین حالت بیمعنا و در بدترین حالت، ابزار دستکاری خواهند بود.

پیامدهای فقدان سواد دادهای

فقدان سواد داده شکافی خطرناک ایجاد میکند بین کسانی که میتوانند دادهها را تفسیر و بهرهبرداری کنند و آنهایی که نمیتوانند. این نابرابری، بازتابی از تکنوکراسیای است که ساگان از آن میترسید؛ جایی که اقلیتی کوچک، دانش را در اختیار دارند و باقی جامعه در برابر دستکاری آسیبپذیر است.

۱. اطلاعات نادرست و گمراهکننده

آمارهای گمراهکننده و تصاویر دستکاریشده در صدر اخبار و شبکههای اجتماعی قرار دارند و به سوتفاهم گسترده میانجامند. در طول همهگیری کووید-۱۹، ارائه انتخابی دادهها، سردرگمی عمومی و بیاعتمادی نسبت به سیاستهای بهداشتی را تشدید کرد. این دقیقاً بازتاب نگرانی ساگان از جامعهای است که توانایی تمایز میان احساس حقیقت و واقعیت تجربی را ندارد. بدون سواد داده، مردم در برابر دستکاری احساسی از طریق دادههای تحریفشده، آسیبپذیر میمانند.

۲. اتکای بیش از حد به هوش مصنوعی

با گسترش نقش هوش مصنوعی در تصمیمگیری، بسیاری از افراد خروجیهای آن را بدون پرسش از پیشفرضها و سوگیریهای سیستم، غیرقابل خطا میدانند! بهعنوان مثال، الگوریتمهای سوگیر استخدامی یا سیستمهای ارزیابی اعتباری مبتنی بر هوش مصنوعی که علیه گروههای به حاشیه راندهشده تبعیض قائل میشوند، نشان از ناتوانی در ارزیابی انتقادی «جعبه سیاه» هوش مصنوعی دارد. هشدار ساگان در مورد خطر کنترل فناورانه توسط اقلیت، اینجا نیز طنینانداز میشود، چرا که عموم جامعه مهارتهای لازم برای پاسخگو کردن سازندگان هوش مصنوعی را ندارند.

۳. نابرابری دادهای

شرکتهایی که تواناییهای پیشرفته داده دارند، صنایع را تحت سلطه خود درمیآورند و شکاف «دادهای» ایجاد میکنند. کسبوکارهای کوچک و کشورهای در حال توسعه اغلب عقب میمانند و نمیتوانند بهطور مؤثر از دادهها بهرهبرداری کنند. این نابرابری فزاینده، بازتابی از ترس ساگان از تکنوکراسی است، جایی که دسترسی یا عدم دسترسی به دانش، به ابزاری برای قدرت و سرکوب بدل میشود.

۴. اتاقهای پژواک و دوقطبی شدن

الگوریتمهای شبکههای اجتماعی اطلاعاتی را به کاربران نشان میدهند که با باورهای پیشین آنها همراستا است، و این به تقویت سوگیریها و شکافهای اجتماعی میانجامد. این پدیده مستقیما با پیشبینی ساگان از جامعهای که از ارزیابی انتقادی جدا شده، همراستا است؛ جایی که ناتوانی در چالش با روایتهای غالب، جهل و قبیلهگرایی را گسترش میدهد.

سواد داده چگونه میتواند ما را از آینده تاریک ساگان نجات دهد؟

در حالی که چشمانداز ساگان ممکن است تیره به نظر برسد، اما در واقع فراخوانی برای عمل است. پادزهر «جهان تسخیرشده با ارواح»، در توانمندسازی افراد با مهارتهای برخورد انتقادی با دادهها و سیستمهایی که آن را تولید میکنند نهفته است. سواد داده، صرفا یک مهارت فنی نیست؛ بلکه عنصری بنیادی برای شهروندی آگاه و تصمیمگیری اخلاقمدار است.

نقشهای کلیدی سواد داده

۱. دموکراتیزه کردن دانش: سواد داده تضمین میکند که همه، نه فقط اقلیتی خاص، توانایی درک و استفاده از داده را داشته باشند. این دموکراتیزهسازی از تمرکز قدرت در دستان دارندگان داده جلوگیری کرده و به ایجاد جامعهای عادلانهتر کمک میکند.

۲. مقابله با اطلاعات نادرست: آموزش ارزیابی انتقادی منابع، شناسایی سوگیریها و پرسش از پیشفرضها، افراد را در برابر دستکاری مصون میکند—مهارتی حیاتی در عصری که اطلاعات نادرست بهسرعت در فضای مجازی گسترش مییابد.

۳. تعادل میان قضاوت انسانی و داده: سواد داده بر این نکته تأکید دارد که تصمیمگیری مبتنی بر داده، به معنای اطاعت کورکورانه از دادهها نیست، بلکه ترکیبی از تحلیل داده و قضاوت انسانی است.

۴. کاربرد اخلاقی دادهها: با نقش فزاینده دادهها در سیاستگذاری و فناوری، ملاحظات اخلاقی اهمیت بیشتری مییابند. سواد داده شامل درک تأثیر تصمیمات مبتنی بر داده بر حریم خصوصی، عدالت و جامعه است.

۵. آمادگی برای آینده: آینده کار و تصمیمگیری، نیازمند حرکت در میان محیطهای دادهای پیچیده است. سواد داده، افراد را برای سازگاری، نوآوری و شکوفایی در این چشمانداز آماده میسازد.

نگاهی به آیندهای پادآرمانشهری بر پایه داده

برای بسط دیدگاه ساگان به آینده، باید پیشبینیهای جسورانه زیر را در نظر بگیرید اگر داده بدون سواد همچنان مهار نشود. چنانکه تاریخ نشان داده، جوامعی که نتوانند شکافهای دانشی را پر کرده و مردم خود را توانمند سازند، آسیب خواهند دید؛ در حالی که جوامعی که سواد—خواه خواندن، علم، یا اکنون، داده—را در اولویت قرار میدهند، پیشرفت خواهند کرد. خطرات جهانی بیسوادی (در بحث ما بیسوادی داده) پدیدهای تازه نیستند؛ آنها صرفا تکراری از الگوهاییاند که پیشتر نیز دیدهایم.

پیشبینی ۱- سلطه هوش مصنوعی بر سیاستگذاری، دموکراسی را به نمایشی ظاهری بدل میکند

هوش مصنوعی بر سیاستگذاری مسلط خواهد شد و الگوریتمها در مورد بودجه، آموزش و سیاستهای سلامت تصمیم خواهند گرفت در حالی که عموم مردم فاقد مهارتهای لازم برای درک یا به چالش کشیدن این تصمیمات خواهند بود. در نتیجهی این وضعیت است که دموکراسی به خطر میافتد و به یک نمایش توخالی تبدیل میشود.

مقایسه تاریخی: ظهور اقتدارگرایی بوروکراتیک

همانطور که تصمیمگیری متمرکز در اتحاد جماهیر شوروی با تکیه بر برنامههای پنجساله خشک و غیرمنعطف، قدرت را از مردم گرفت، حکومتداری مبتنی بر هوش مصنوعی نیز ممکن است تصمیماتی را اتخاذ کند که از نظارت انسانی بینصیب ماندهاند.

مثال دیگر، پروژه سایبرسین در شیلی دهه ۱۹۷۰ است؛ تلاشی ناکام برای مدیریت مرکزی اقتصاد با استفاده از سامانهای شبیه به هوش مصنوعی. هدف آن بهینهسازی صنایع ملی از طریق دادههای لحظهای بود، اما نگرانیهایی درباره کنترل و نظارت دولتی برانگیخت؛ مشکلاتی که امروز نیز با حکمرانی مبتنی بر هوش مصنوعی تکرار شدهاند.

به همین ترتیب، در سیستم اعتبار اجتماعی چین، الگوریتمهای هوشمند رفتار شهروندان را دنبال و امتیازدهی میکنند، که بر مواردی چون دریافت وام یا اجازه سفر تأثیر میگذارد. با افزایش اتکای ما به هوش مصنوعی، نظارت دموکراتیک میتواند تضعیف شده و حاکمیت به سیستمی opaque و مبهم تبدیل شود که در آن شهروندان نه توسط انسانها بلکه توسط الگوریتمهای نامرئی قضاوت میشوند.

پیشبینی ۲- شکلگیری طبقه جدید: نخبگان دادهمحور در برابر بیسوادهای دادهای

طبقهای جدید شکل خواهد گرفت: نخبگان دادهدان و اکثریت دادهبیسواد. این شکاف، دسترسی به فرصتها را تعیین خواهد کرد و شکل جدیدی از نابرابری را بهوجود میآورد.

ما بهسوی یک اقتصاد دیجیتال نمیرویم؛ بلکه بهسوی یک اشرافیت دادهمحور حرکت میکنیم!

مقایسه تاریخی:

در دوران انقلاب صنعتی، صاحبان کارخانهها و صنعتگران پیشرفت کردند، در حالی که کارگران بیمهارت در شرایط سخت باقی ماندند. در آیندهای مبتنی بر داده، کسانی که داده را درک و کنترل میکنند، قدرت انباشته خواهند کرد و دیگران در فقر اطلاعاتی و اجتماعی فرو خواهند رفت.

نمونه معاصرتر، شکاف دیجیتال دهه ۱۹۹۰ و ۲۰۰۰ است. با محوریت یافتن اینترنت در کسبوکار و آموزش، کسانی که به ابزار دیجیتال دسترسی داشتند، پیشرفت کردند و دیگران عقب ماندند. این شکاف اکنون بهسوی سواد داده در حال حرکت است، جایی که مهندسان هوش مصنوعی، دانشمندان داده و نخبگان فناور، قدرت نابرابری را در دست دارند و آنهایی که فاقد این مهارتها هستند، بهطور فزایندهای در حاشیه قرار میگیرند.

این شرایط شبیه عصر طلایی سرمایهداری (Gilded Age) در اواخر قرن ۱۹ است، جایی که ثروت در دست معدودی از غولهای صنعتی مانند صاحبان خطوط راهآهن و نفت انباشته شده بود. همانگونه که قدرت اقتصادی آن زمان بر کنترل منابع صنعتی استوار بود، در آینده نیز جامعهای را تصور میکنیم که دسترسی به داده، تعیینکننده تحرک مالی و اجتماعی است.

پیشبینی ۳- فلج سازمانها به علت «درماندگی دادهای» (Data Paralysis)

سازمانهایی که در سرمایهگذاری روی سواد داده ناکام بمانند، دچار «استیصال یا درماندگی دادهای» خواهند شد و در برابر حجم عظیم اطلاعات قادر به تصمیمگیری نخواهند بود. فاجعه آنجاست که صنایع بالغ و بزرگ هم ممکن است به علت تصمیمگیری ضعیف در این خصوص، فروبپاشند.

قبرستان کسبوکارهای شکستخورده پر از شرکتهایی است که همه دادهها را داشتند؛ ولی نمیدانستند با آن چه کنند!

مقایسه تاریخی:

سقوط امپراتوری روم تا حدی ناشی از بوروکراسی گسترده و کند آن بود که در پردازش و اقدام بر اساس اطلاعات حیاتی ناکارآمد بود. بهطور مشابه، بحران مالی ۲۰۰۸ ناشی از اعتماد بیش از حد به مدلهای مالی پیچیدهای بود که ریسک را بهدرستی نشان نمیدادند—داده زیاد، ولی فهم اندک.

مثال دیگر، بحران نفتی ۱۹۷۳ است که در آن آمریکا و کشورهای غربی، به دلیل ناتوانی در تفسیر سیگنالهای بازار انرژی و تکیه بر مدلهای پیشبینی قدیمی، دچار سردرگمی و تصمیمگیریهای نادرست شدند.

نمونه نزدیکتر، سقوط شرکت کداک در اوایل دهه ۲۰۰۰ است؛ با وجود دسترسی به دادهها و نوآوریهای اولیه در عکاسی دیجیتال، رهبری آن شرکت در اتخاذ تصمیمهای درست دچار فلج شد، چرا که مدلهای تجاری سنتی را رها نکرد. سازمانهایی که امروز نتوانند دادهها را به درستی تحلیل و تفسیر کنند، با سرنوشتی مشابه روبرو خواهند شد.

پیشبینی ۴- اطلاعات نادرست، اعتماد را از بین میبرد و جامعه را متلاشی میکند

کمپینهای اطلاعات نادرست پیشرفته، اعتماد عمومی را بهطور کامل از بین خواهند برد و جامعه را آنچنان دچار تفرقه میکنند که دیگر توان اقدام جمعی بر روی مسائل حیاتی مانند تغییرات اقلیمی یا سلامت جهانی باقی نمیماند.

جنگ بر سر حقیقت با گلوله انجام نمیشود، بلکه با الگوریتمها پیش میرود.

مقایسه تاریخی:

اختراع چاپ، انقلاب دانش را ممکن ساخت اما همچنین اطلاعات نادرست را نیز گسترش داد، که به شکافهای عمیق اجتماعی در جریان اصلاحات پروتستانی منجر شد.

تبلیغات دوران جنگ سرد، در هر دو سوی ایالات متحده و اتحاد جماهیر شوروی، ادراک عمومی را شکل داد؛ درست مانند کمپینهای اطلاعات نادرست امروزی که با کمک هوش مصنوعی، گفتمان عمومی را دستکاری میکنند.

یک نمونه برجسته، نحوهای است که ایالات متحده و شوروی در دوران جنگ سرد، اطلاعات نادرست را به سلاح تبدیل کردند تا ادراک عمومی از تسلیحات هستهای و نفوذ جهانی را تغییر دهند. در آمریکا، عملیات Mockingbird شامل نفوذ سرویسهای اطلاعاتی به رسانهها و روزنامهنگاران بود تا روایتهای ضدکمونیستی را گسترش دهند و تهدید شوروی را بزرگنمایی کنند. در سوی دیگر، عملیات INFEKTION اتحاد جماهیر شوروی، این شایعه را پخش کرد که ویروس HIV/AIDS ساخته دست آمریکا است. این شایعه جهانی شد و به بیاعتمادی نسبت به نهادهای پزشکی غربی دامن زد.

این نمونهها نشان میدهند که اطلاعات و دادههای نادرست، حتی زمانی که از استراتژیهای ژئوپولیتیکی ناشی میشوند، چگونه اعتماد به نهادها را از بین برده و جامعه را از درون متلاشی میکنند. وقتی اطلاعات نادرست مهار نشوند، جامعه از هم میپاشد و دیگر نمیتواند در برابر بحرانهایی مانند تغییرات اقلیمی یا همهگیریهای جهانی، واکنش هماهنگ نشان دهد.

تاریخ خود را تکرار میکند مگر آنکه از آن بیاموزیم

این نمونههای تاریخی نشان میدهند که جوامع باید خود را با شکافهای دانشی نوین تطبیق دهند؛ در غیر این صورت، با پیامدهای سنگینی مواجه خواهند شد. تفاوت اکنون این است که داده و هوش مصنوعی این فرایندها را با سرعتی بیسابقه شتاب میبخشند، و این یعنی ریسکها نیز بسیار بالاتر رفتهاند.

اگر چارهای نیندیشیم، با جهانی روبرو خواهیم شد که قدرت در دست کسانی خواهد بود که داده را درک میکنند، و دیگران در معرض دستکاری، کنترل یا محرومیت اقتصادی قرار خواهند گرفت.

هشدار کارل ساگان، تنها درباره بیسوادی علمی نبود؛ بلکه در مورد خطرات ناتوانی جامعه در درک و به چالش کشیدن دادهها نیز بود. اگر شکاف سواد داده را پر نکنیم، تاریخ نه تنها تکرار خواهد شد، بلکه به شکلی بسیار بدتر تکامل خواهد یافت. چرا که در عصر هوش مصنوعی و کلانداده، کسانی که نمیتوانند پرسش کنند، تفسیر کنند و اعداد را به چالش بکشند، صرفا ناآگاه نخواهند بود؛ بلکه تحت سلطه خواهند بود.

همانطور که ساگان به یادمان آورد:

«علم تنها مجموعهای از دانش نیست؛ بلکه روشی برای اندیشیدن است».

همین را میتوان درباره سواد داده نیز گفت. سواد داده، یک گزینه اختیاری نیست؛ بلکه ابزار بقا است.

انتخاب ساده است:

با داده بیندیش، یا تحت کنترل کسانی باش که میاندیشند.